Perchè il futuro non ha bisogno di noi

di Bill Joy

pubblicato su Wired aprile

2000

(trad. Tactical Media Crew)

Le nostre più potenti tecnologie del 21' secolo - scienze

robotiche, ingegneria genetica e nanotecnologia - minacciano di far degli umani

una specie a rischio

(Bill Joy, cofondatore e caposcienziato di Sun Microsystems,

e' stato dirigente della commissione presidenziale sul futuro della ricerca IT,

ed è coautore delle specifiche del liguaggio Java. Si può leggere anche del suo

lavoro su: "Jini pervasive computing technology" in Wired 6.08. )

Dal momento che sono stato coinvolto nella

creazione di nuove tecnologie, la loro dimensione etica mi ha preoccupato, ma è

stato solamente nell'autunno del 1998 che sono diventato ansiosamente

consapevole di quanto grandi siano i pericoli che ci si propongono nel 21'

secolo. Posso dar inizio del mio sconforto al giorno in cui ho incontrato Ray

Kurtzweil, il meritatamente famoso inventore della prima macchina per leggere,

per ciechi, ed altre cose stupefacenti.

Dal momento che sono stato coinvolto nella

creazione di nuove tecnologie, la loro dimensione etica mi ha preoccupato, ma è

stato solamente nell'autunno del 1998 che sono diventato ansiosamente

consapevole di quanto grandi siano i pericoli che ci si propongono nel 21'

secolo. Posso dar inizio del mio sconforto al giorno in cui ho incontrato Ray

Kurtzweil, il meritatamente famoso inventore della prima macchina per leggere,

per ciechi, ed altre cose stupefacenti.

Ray ed io eravamo entrambi oratori

alla conferenza George Gilder's Telecosm, e lo incontrai per caso nel bar

dell'hotel dopo che le nostre sessioni erano finite. Ero seduto con John Searle,

un filosofo dell'Università di Berkley che studia la percezione. Mentre

parlavamo, Ray si avvicino e incomincio la conversazione, il soggetto , quello

che a tutt'oggi mi perseguita.

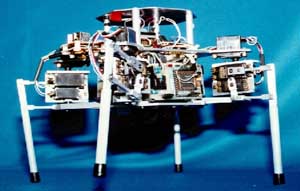

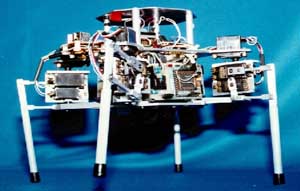

Mentre avevo sentito già tali discorsi, avevo sempre pensato che i robot

senzienti appartenessero al dominio della fantascienza. Ma ora, da qualcuno che

rispettavo, stavo ascoltando la forte argomentazione che erano una possibilità a

breve termine. Ero sconcertato, specialmente conoscendo la provata abilità di

Ray di immaginare e creare il futuro. Sapevo già che le nuove tecnologie come

l'ingeneria genetica e la nanotecnologia ci stavano dando il potere di rifare il

mondo, ma un realistico ed imminente scenario di robot intelligenti mi ha

stupito.

E' facile rimanere spossati da tali innovazioni. Sentiamo dalle notizie quasi

tutti i giorni di qualche progresso tecnologico o scientifico. Tuttavia questa

non era una predizione consueta. Nel bar del hotel, Ray mi diede una prestampa

del suo prossimo libro "The Age of Spiritual Machines", che delineava l'utopia

che prevedeva - una era in cui gli umani, diventando un tuttuno con la

tecnologia robotica, si avvicinavano all'immortalità. Leggendolo, il mio senso

di sconforto si intensificò; ero sicuro che stava capendo i pericoli, capendo la

probabilità di un esito negativo lungo questo cammino.

Mi son trovato molto

turbato da un passaggio che delinea uno scenario distopico.

La nuova sfida luddista

Per prima cosa, lasciateci postulare che gli

scienziati informatici riescano a sviluppare macchine intelligenti che possano

fare tutto meglio degli esseri umani. In quel caso, presumibilmente, tutto il

lavoro sarà fatto da vasti ed organizzati sistemi di macchine e nessuno sforzo

umano sarà necessario.Entrambi i casi possono accadere. Alle macchine potrebbe

essere permesso di prendere tutte le proprie decisioni senza la supervisione

umana, o altrimenti il controllo sulle macchine potrebbe essere contenuto.

Se alle macchine è permesso di prendere le proprie decisioni, non possiamo

fare alcuna congettura sul risultato, perchè sarà impossibile indovinare come

tali macchine potranno comportarsi. Noi indichiamo soltanto come il destino

della razza umana sarà alla mercè delle macchine. Si potrebbe obiettare

affermando che la razza umana non sarebbe mai così stolta da consegnare tutto il

potere alle macchine. Ma non stiamo altresì suggerendo che gli umani

volontariamente consegnerebbero il potere alle macchine o che le macchine di

proposito si impossesserebbero del potere. Quello che suggeriamo, è che la razza

umana possa facilmente lasciarsi scivolare verso una posizione di totale

dipendenza dalle macchine per cui non possa avere alternativa che accettare

tutte le decisioni prese dalle macchine. Visto che la società ed i suoi problemi

diventano sempre più complicati, e le macchine sempre più intelligenti, le

persone lasceranno che le macchine prendano sempre più le decisioni per loro,

semplicemente perchè decisioni fatte dalle macchine porteranno migliori

risultati che quelle fatte dagli esseri umani. Si arriverà prima o poi ad uno

stadio in cui le decisioni da prendere per mantenere il sistema saranno così

complicate che gli esseri umani non saranno in grado di farle in modo

intelligente. A quel punto le macchine avranno effettivamente il controllo. Le

persone non saranno semplicemente in grado di spegnere le macchine, perchè ne

saranno così dipendenti da far risultare lo spegnimento un suicidio.

D'altra parte è possibile che il controllo umano sulle macchine possa essere

conservato. In questo caso l'uomo medio potrà avere controllo su alcune sue

macchine private, come la sua macchina o il suo pc, ma il controllo dei grandi

sistemi sarà nelle mani di una piccola élite - così com'è oggi, ma con due

differenze. Per il miglioramento della tecniche, l'élite avrà un controllo

maggiore sulle masse; e visto che il lavoro umano non sarà più necessario, le

masse saranno superflue, un inutile fardello per il sistema. Se l'élite fosse

spietata, allora potrebbero semplicemnte decidere di sterminare la massa

dell'umanità. Se fosse compassionevole allora potrebbero utilizzare la

propaganda, o altre tecniche psicologiche o biologiche per diminuire il tasso di

nascita fino a che la massa si estingua, lascinado il mondo all'élite. Oppure,

se l'élite consiste di liberali dal cuore tenero, potrebbero decidere di

interpretare la parte del buon pastore nei confronti del resto del mondo.

Saranno accorti che le necessità fisiche di ognuno siano soddisfatte,

provvederanno a che tutti i bambini crescano in un ambiente fisicamente e

psicologicamente igienico, che ognuno abbia un qualsiasi hobby per

intrattenerlo, e che chiunque possa sentirsi insoddisfatto possa intrapprendere

una “terapia” per curare il suo “problema”. Certamente la vita sarà così priva

di scopo che le persone dovranno essere psicologicamente o biologicamente

progettate per rimuovere il proprio bisogno per il processo di potere o di

subliminare la loro ricerca di potere in qualche innocuo hobby. Questi esseri

umani progettati potrebbero essere felici in tale società, ma non saranno

certamente liberi. Saranno stati ridotti allo stato di animali domestici.(1)

Nel libro, non scopri fino a che non giri pagina che l'autore di questo

passaggio è Theodore Kaczynski - l'Unabomber. Non sono un difensore di

Kaczynski. Le sue bombe hanno ucciso tre persone durante la sua campagna

diciasettennale di terrore ed ha ferito molti altri. Una delle sue bombe ha

ferito gravemente il mio amico David Gelernter, uno dei più brillanti e

visionari scienziati informatici del nostro tempo. Come molti dei miei colleghi,

ho sentito di poter essere il prossimo bersaglio dell'Unabomber.

Le gesta di

Kaczynski erano a mio avviso omicide e criminalmente folli. Lui è chiaramente un

luddista, ma la semplice affermazione di questo non rigetta il suo discorso;

benché mi sia difficile da accettare, ho visto dei meriti sui ragionamenti di

questo singolo passaggio. Mi sono sentito costretto a confrontarmici.

La visione distopica di Kaczynski descrive consequenze involontarie, un

problema ben noto con la progettazione ed uso della tecnologia, ed uno che è

chiaramente relazionato alla legge di Murphy - “Se c'é qualcosa che può andare

storto, lo andrà”.(In realtà, questa è la legge di Finagle, che in se stessa

dimostra che Finagle aveva ragione). Il nostro abuso di antibiotici ha portato a

quello che è forse il più grande problema fino ad ora: l'emergere di batteri

molto più pericoloso e resistente agli antibiotici. Simili cose sono successe

quando si è tentato di eliminare i moschito portatori di malaria con il DDT,

facendoli acquisire una resistenza al DDT; parassiti malarici similarmente

acquisiscono geni multi-medicine-resistenti.(2)

La causa di tante sorprese sembra chiara: I sistemi coinvolti sono complessi,

coinvolgendo interazione e reazione tra le molte parti. Qualsiasi cambiamento a

questo sistema produrrà effetti a cascata che sono difficili da prevedere;

questo è specialmente vero quando sono coinvolte azioni umane.

Ho incominciato a mostrare ad amici l'estratto di Kaczynski da The Age of

Spiritual Machines; davo loro il libro di Kurzweil, lasciandoli leggere il

passo, e poi osservavo la loro reazione appena scoprivano chi l'aveva scritto.

Più o meno nello stesso periodo, ho trovato il libro di Hans Moravec Robot: Mere

Machine to Transcendent Mind. Moravec è uno dei leader nella ricerca robotica, e

fu fondatore di uno dei più grandi programmi di ricerca sulla robotica alla

Carnegie Mellon University. Robot mi diede altro materiale da provare sui miei

amici - materiale sorprendentemente sostenitore delle teorie di Kaczynski. Ad

esempio:

La breve corsa ( primi anni 2000)

Le specie biologiche quasi mai sopravvivono allo scontro con un

competitore superiore. Diecimilioni di anni fa, il sud e il Nord America erano

separati da uno sprofondato istmo di Panama. Il Sud America, come oggi

l'Australia, era popolata da mammiferi marsupiali, compresi marsupiali

equivalenti di ratti, cervi e tigri. Quando l'istmo che connetteva Nord e Sud

America sorse, ci sono voluti solamente poche migliaia di anni perchè le specie

placentali, con metabolismi, sistemi riproduttivi e nervosi di poco più

efficaci, destituissero ed eliminassero quasi tutti i marsupiali del sud.

Le specie biologiche quasi mai sopravvivono allo scontro con un

competitore superiore. Diecimilioni di anni fa, il sud e il Nord America erano

separati da uno sprofondato istmo di Panama. Il Sud America, come oggi

l'Australia, era popolata da mammiferi marsupiali, compresi marsupiali

equivalenti di ratti, cervi e tigri. Quando l'istmo che connetteva Nord e Sud

America sorse, ci sono voluti solamente poche migliaia di anni perchè le specie

placentali, con metabolismi, sistemi riproduttivi e nervosi di poco più

efficaci, destituissero ed eliminassero quasi tutti i marsupiali del sud.

In un mercato completamente libero, robot superiori sicuramente colpirebbero

gli umani come i placentali Nord Americani colpirono i marsupiali Sud Americani

(e come gli umani hanno colpito innumerevoli specie). Le industrie robotiche

entrerebbero in competizione tra di loro fortemente per interesse, energia e

spazio, incidentalmente portando il loro prezzo oltre le possibilità umane.

Incapaci di permettersi tali necessità della vita, gli umani biologici sarebbero

schiacciati via dall'esistenza.

C'è probabilmente ancora possibilità di

respiro, giacchè non viviamo in un mercato completamente libero. I governi

forzano comportamenti non atti al mercato, specialmente con l'accumulo delle

tasse. Applicandolo con giudizio, la coercizione governativa potrebbe sostenere

un alto stile di vita per le popolazioni umane frutto del lavoro dei robot per

forse un lungo tempo.

Continua a focalizzare su come il nostro lavoro per

il 21'secolo sarà di “assicurare la continua cooperazione dalle industrie

robotiche” formulando leggi che decretino che essi siano “buoni”,(3) e a

descrivere quanto seriamente pericoloso possa essere un umano “una volta

trasformato in un robot super intelligente senza limiti”. L'opinione di Moravec

è che prima o poi i robot ci succederanno - che gli umani evidentemente si

affacciano all'estinzione.

Decisi che era ora di parlare al mio amico Danny Hillis. Danny divenne famoso

come cofondatore della Thinking machines corporation, che costruì un super

computer parallelo molto potente. Nonostante il mio attuale incarico di "Chief

Scientist" - Capo scienziato - alla Sun Microsystems, sono più un'architteto di

computer che uno scienziato, e rispetto molto il sapere sull'informazione e

sulle scienze fisiche di Danny più che quello di qualunque altra persona. Danny

è anche un futurista altamente considerato, che pensa a lungo raggio - quattro

anni fa incominciò la Fondazione Long Now, che sta costruendo un orologio

progettato per durare 10000 anni con la volontà di attrarre l'attenzione sulla

pietosa corta durata di attenzione della nostra società.

Quindi sono andato

a Los Angeles con il chiaro intento di cenare con Danny e sua moglie, Paty. Ho

fatto la mia ormai familiare routine facendo trottare le mie idee ed i passaggi

che trovavo così fastidiosi. La risposta di Danny - mirata specificatamente allo

scenario, di Kurzweil, di umani che si fondono con i robot - venne rapidamente e

mi stupì alquanto. Disse, semplicemente, che i cambiamenti sarebbero avvenuti

gradualmente e che ci saremmo abituati.

Ma credo che ero del tutto stupito.

Avevo visto una citazione di Danny nel libro di Kurzweil la quale diceva, “amo

il mio corpo come chiunque altro ma se posso essere 200 con un corpo di

silicone, mi va bene”. Sembrava che lui fosse in pace con questo processo e con

i rischi annessi, mentre io no.

Parlando e pensando su Kurzweil, Kaczynski e Moravec, improvisamente mi sono

ricordato di un romanzo che avevo letto quasi più di venti anni fa - The White

Plague, di Frank Herbert - nel quale un biologo molecolare impazzisce per

l'insensato omicidio della sua famiglia. Per vendicarsi costruisce e dissemina

una piaga altamente contagiosa che uccide in maniera vasta ma selettiva. (Siamo

fortunati che Kaczynski era un matematico e non un biologo molecolare). Mi era

venuto alla mente anche i Borg di Star Trek, un misto di creature in parte

biologiche ed in parte robotiche con un forte senso distruttivo. Disastri da

“Borg” sono il soggetto per eccellenza della fantascienza, quindi per quale

motivo non mi ero preocupato prima per tali distopie robotiche? Perchè altre

persone non erano turbate da questi scenari da incubo?

Parte della risposta

sicuramente è nella nostra attitudine verso il nuovo - nella nostra tendenza

all'instantanea familiarità e accettazione acritica. Abituati a vivere con ormai

scoperte scientifiche di routine, dobbiamo ancora arrivare al fatto che le

tecnologie del 21' secolo, robotica, ingegneria genetica e nanotecnologia,

pongono una nuova minaccia rispetto alle tecnologie venute prima.

Specificamente, Robot, organismi progettati e nanobots condividono lo stesso

pericolo: possono auto-replicarsi. Una bomba è fatta esplodere una volta sola -

ma un bot può diventare molti e velocemente essere incontrollabile.

Molto del mio lavoro negli ultimi 25 anni è stato mirato al computer

networking, dove il mandare e ricevere messaggi crea l'opportunità per la

replicazione incontrollabile. Tuttavia mentre la replicazione in un computer o

in una rete di computer può essere un danno, al peggio disabilita una macchina o

la rete o un servizio di rete. L'incontrollata auto-replicazione in queste

tecnologie più moderne incorre in un rischio maggiore: il rischio di un danno

sostanziale nel mondo fisico.

Ciascuna di queste tecnologie offrono una

promessa non detta: la visione di vicina immortalità che Kurzweil vede nei suoi

sogni robotici ci porta avanti; l'ingegneria genetica presto potrebbe portare

trattamenti, se non cure complete, per la maggioranza delle epidemie; e la

nanotecnologia e la nanomedicina possono indirizzarsi ad ancora più malattie.

Insieme potrebbero in maniera significativa aumentare la nostra soglia di vita e

migliorare la qualità della nostra vita. Tuttavia, con ciascuna di queste

tecnologie una sequenza di piccoli, individualmente sensibili passi in avanti

portano ad un accumulo di enorme potere ed in concomitanza quindi ad un grande

pericolo.

Qual'era la differenza nel 20' secolo? Certamente le tecnologie

dietro le armi per la distruzione di massa (Weapons of Mass Destruction, WMD) -

nucleare, biologica e chimica (NBC) - erano potenti e le armi una minaccia

enorme. Ma costruire armi nucleari richiedeva, almeno per un periodo, accesso a

entrambi rari - ed in effetti non disponibili - materiali primari ed

informazioni altamente protette; i programmi per armi biologiche e chimiche

anche tendevano ad aver bisogno di attività su grande scala.

Le tecnologie del 21' secolo - genetica, nanotecnologia, robotica (GNR) -

sono così potenti che possono proliferare una intera nuova classe di incidenti e

abusi. Ancora più pericoloso, per la prima volta, questi incidenti ed abusi sono

largamente alla portata di individui o piccoli gruppi. Non richiederanno grosse

infrastrutture o materiali primari. Il solo sapere ne permetterà l'uso.

Così

abbiamo la possibilità non solo di armi per la distruzione di massa ma anche del

sapere'abilitato alla distruzione di massa (Knowledge-enabled Mass Destruction,

KMD), e questa distruttività enormemente amplificata dal potere della

auto-replicazione.

Credo non sia affatto un'esagerazione l'affermare che

siamo sulla soglia per l'ulteriore perfezionamento del male, un male le quali

possibilità si aprono ben al di là delle armi di distruzione di massa lasciate

alle nazioni-stato, verso un sorprendente e terribile conferimento di potere di

individualità estreme.

Niente nel modo in cui sono stato coinvolto con i computer faceva presagire

che avrei dovuto confrontarmi con tali questioni.

La mia vita è stata guidata

da una profonda necessità di fare domande e trovare risposte. Quando avevo 3

anni, già leggevo, quindi mio padre mi portò alle scuole elementari, dove sedevo

sulle gambe del preside e gli leggevo una storia. Ho incominciato scuola presto,

più tardi ho saltato un anno, e mi sono rifugiato nei libri - ero

incredibilmente motivato ad imparare. Facevo molte domande, spesso conducendo

gli adulti a distrarsi.

Da adolescente ero molto interessato alla scienza ed

alla tecnologia. Volevo diventare un operatore di “baracchini” ma non avevo i

soldi per le attrezzature. I baracchini erano l'internet dell'epoca:

assuefazione e vita solitaria. Ma tralasciando l'aspetto monetario, mia madre si

impuntò perchè io non lo diventassi, ero già abbastanza asociale. Forse non ho

avuto delle strette amicizie, ma ero pieno di idee. Per le superiori avevo già

scoperto i grandi scrittori di Fantascienza. Ricordo specialmente il libro di

Heinlein Have Spacesuit Will Travel e I, Robot di Asimov con le sue tre leggi

della robotica. Ero incantato dalle descrizioni dei viaggi spaziali e desideravo

avere un telescopio per osservare le stelle; visto che non avevo i soldi per

comprarne o costruirne uno, presi dei libri dalla biblioteca per almeno leggere

come costrurli. Mi confortavo con la mia immaginazione.

I giovedì sera i miei

andavano al bowling, e noi ragazzi rimanevamo a casa. Era la notte di Star Strek, l'originale di Gene

Roddenberry, mi meravigliava tanto. Accettai la

nozione che gli esseri umani avevano un futuro nello spazio, tipo West, con

grandi eroi ed avventure. La visione di Roddenberry riguardo al futuro era di un

forte senso morale, impersonificato nel Direttivo Primario: non interferire

nello svilluppo di civilizzazioni tecnologicamente inferiori. Questo mi

affascinava, “etici” esseri umani, e non robot, dominavano il futuro, ed ho

fatto del sogno di Roddenberry parte del mio.

Ho brillato in matematica alle

superiori, e quando sono andato all'università del Michigan come studente

undergraduate di ingegneria, ho preso la carriera di matematica avanzata.

Risolvere problemi matematici era un tipo di confronto eccitante, ma quando ho

scoperto i computer, ho trovato qualcosa di molto più interessante: una macchina

in cui potevi immettere un programma che tentasse di risolvere un problema, per

il quale, dopo, la macchina ti avrebbe dato una soluzione. Il computer aveva una

chiara nozione di corretto ed incorretto, di vero e falso. Le mie idee erano

giuste ? La macchina me lo poteva dire. Questo era molto seduttivo.

Ero stato

abbastanza fortunato di trovare lavoro programmando i primi supercomputer e

scoprire la sorprendente capacità di queste grandi macchine di simulare

numericamente progetti complessi.

Quando frequentavo la graduate school alla

Università di Berkeley, incominciai a rimanere alzato fino a tardi, spesso tutta

la notte, inventando nuovi mondi dentro le macchine, risolvendo problemi,

scrivendo il codice che lottava per non essere scritto.

Nel romanzo biografico di Irving Stone su Michelangelo, The Agony and the

Ecstasy, Stone descrive vividamente come Michelangelo liberava le statue dalla

pietra, “rompendo l'incantesimo di marmo”, modellando dalle immagini della sua

mente. (4) Nei miei momenti di maggiore estasi, il software nel computer

emergeva nello stesso modo. Una volta che l'avevo immaginato, sentivo che era

tutto già nella macchina, in attesa di essere liberato. Rimanere in piedi tutta

la notte sembrava un prezzo veramente modico per liberarlo - per rendere

concrete le idee.

Dopo qualche anno alla Berkeley, incominciai a distribuire

alcuni dei software di mia creazione - un sistema istruzionale in Pascal,

utilità Unix ed un editor di testo chiamato "VI" (che è, con mio stupore, ancora

largamente usato dopo 20 anni) - da altri che avevano simili PDP-11 e VAX

minicomputers. Queste avventure software ad un certo punto confluirono nel

sistema Unix della Berkeley, che divenne un mio personale “disastroso successo”

- talmente tanta gente lo voleva, che non ho finito la mia laurea. Invece

ottenni un lavoro per la Darpa mettendo il Berkeley Unix in Internet

aggiustandolo per essere solido ed inoltre in modo che potesse far girare grosse

applicazioni di ricerca. Questo è stato tutto un gran divertimento e

soddisfazione, e francamente non vedevo alcun robot né qui né ovunque

vicino.

Ancora, agli inizi degli anni 80, stavo in alto mare. Le

distribuzioni di Unix avevano molto successo ed il mio piccolo progetto presto

aveva denaro e collaboratori, ma il problema alla Berkeley non erano i soldi ma

lo spazio, non c'era posto per l'aiuto di cui il progetto aveva bisogno, per

cui, quando gli altri fondatori della Sun Microsystems apparvero, mi fiondai per

unirmi a loro. Alla Sun, le lunghe ore si protrassero fino ai primi giorni delle

worksations e dei personal computers, ed avevo gioito della partecipazione nella

crezione di processori avanzati e di tecnologie per Internet quali Java e Jini.

Da tutto ciò, confido che sia chiaro che non sono un

luddista. Il mio

lavoro ha avuto molto più impatto di quello sperato ed è stato utilizzato molto

di più di quanto ragionevolmente mi aspettavo. Ho ancora passato gli ultimi 20

anni a capire come rendere i computer affidabili quanto io mi aspetto che essi

lo siano (e non sono ancora così) e a come renderli semplici da usare (un

obiettivo ancora relativamente meno raggiunto).

Nonostante un po' di

progresso, i problemi che rimangono sembrano ancora più

scoraggianti.

Tuttavia mentre ero consapevole dei dilemmi morali riguardo

alle consequenze tecnologiche in campi come la ricerca sulle armi, non mi

aspettavo di dover confrontare tali dilemmi nel mio campo, o almeno non così

presto.

Forse è sempre difficile vedere l'impatto grande quando sei coinvolto

nel vortice più piccolo proprio del cambiamento. Sembra una comune colpa di

scienziati e tecnologicisti di non capire le consequenze delle proprie

invenzioni mentre siamo rapiti dalla scoperta; siamo stati guidati per molto

tempo dall' estremo desiderio di sapere, che è la natura della ricerca

scientifica, non fermandoci a notare che tecnologie più nuove e potenti possono

prendere vita propria.

E' da molto che ho realizzato che la information technology non fa i suoi

passi più grandi grazie agli scienziati di computer, agli architetti di computer

o agli ingegneri elettronici, ma ai fisici. I fisici Stephen Wolfram e Brosl

Hasslacher mi introdussero, nei primi anni 80, alla teoria del caos ed ai

sistemi non lineari. Negli anni 90, ho appreso dei sistemi complessi dalle

conversazioni con Danny Hill, il biologo Stuart Kauffman, il nobel per la fisica

Murray Gell-Mann, ed altri. Recentemente, Hasslacher e l'ingegnere elettronico e

fisico Mark Reed mi hanno introdotto alle incredibili possibilità

dell'elettronica molecolare.

Nel mio lavoro, come co-disegnatore di 3

architetture di microprocessori - SPARC, picoJava e MAJC - e come disegnatore

delle successive implementazioni, ho avuto modo di avere una profonda

dimestichezza ed in prima persona della legge di Moore. Per decine di anni, la

legge di Moore ha correttamente previsto il tasso di miglioramento della

tecnologia a semiconduzione. Fino all'anno scorso, ho pensato che il raggio di

avanzamenti previsto dalla legge di Moore potesse continuare fino al 2010 circa,

quando alcuni limiti fisici saranno stati raggiunti. Non mi era affato ovvio che

una nuova tecnologia sarebbe arrivata per permettere il tranquillo progresso dei

risultati.

Ma dato il recente rapido e radicale progresso nell'elettronica

molecolare - dove atomi e molecole individuali rimpiazzano transistor disegnati

litograficamente - e nelle relazionate tecnologie nanoscalari, dovremmo essere

in grado di arrivare o di superare il tasso di progresso della legge di Moore

per altri 30 anni.

E' verosimile che per il 2030 saremo in grado di

costruire, in quantità, macchine un milione di volte più potenti dei personal

computer di oggi - sufficiente per implementare i sogni di Kurzweil o Moravec.

Visto che questo enorme potere computeristico si combina con il progresso

della fisica sulla manipolazione e il profondo sapere sulla genetica, si sta

liberando un potere immenso di trasformazione. Queste combinazioni danno la

possibilità di ridisegnare il mondo, in meglio o in peggio: i processi di

replicazione e di evoluzione che fino adesso erano confinati al mondo naturale

stanno per diventare dominio degli sforzi umani.

Nel progettare i software e

i microprocessori, non ho mai avuto la sensazione che stavo disegnando una

macchina intelligente. Il software sono l'hardware sono così fragili e le

capacità per una macchina di "pensare" sono così chiaramente assente che, anche

come possibilità, questo è sempre sembrato molto lontano nel futuro.

Ma ora,

calcolando il livello del potere computeristico umano, in una prospettiva di

circa 30 anni, una nuova idea si propone: che io stia lavorando per creare

strumenti che permetteranno la costruzione di tecnologie che possono sostituire

la nostra specie. Come mi sento per questo? Molto a disagio. Avendo faticato per

tutta la carriera a costruire sistemi e software affidabili, mi sembra più che

probabile che il futuro non si risolverà così bene come alcune persone possono

immaginare. La mia personale esperienza mi suggerisce che tendiamo a

sopravvalutare le nostre abilità di progettazione.

Dato l'incredibile potere

di queste nuove tecnologie, non dovremmo chiederci come coesistere al meglio con

loro? E se la nostra stessa estinzione è un probabilmente o anche possibile,

effetto del nostro sviluppo tecnologico, non dovremmo procedere con grande

prudenza?

Il sogno della robotica è, prima di tutto, che macchine intelligenti possano

lavorare al posto nostro, permettendoci vite lussuose, ridandoci l'Eden.

Tuttavia, George Dyson nella sua storia concernente tali idee, "Darwin Among the

machine", ci avverte: "Nel gioco della vita e l'evoluzione ci sono tre

giocatori: gli esseri umani, la natura, e le macchine. Sono fermamente dalla

parte della natura. Ma la natura, sospetto, è dalla parte delle macchine". Come

abbiamo visto, Moravec concorda, nel credere che sia probabile che non

sopravviveremo allo scontro con la specie superiore dei robots.

Quanto presto

potrebbe essere costruito un robot intelligente? Stando agli sviluppi

tecnologici sembra che questo sia possibile entro il 2030. E una volta creato il

robot intelligente, il passo per la specie Robot è breve, perchè un robot

intelligente possa fare copie evolute di se stesso.

Un secondo sogno di

robotica è che gradualmente ci rimpiazzeremo con la nostra tecnologia robotica,

e scaricando le nostre coscienze raggiungendo quasi l'immortalità; è questo

processo a cui Danny Hillis pensa che gradualmente ci abitueremo e che Ray

Kurzweil elegantemente descrive nel suo libro "The Age of Spiritual Machines".

(Stiamo cominciando a vedere intimazioni di questo nell'impianto di apparecchi

computerizzati nel corpo umano, come illustrato nella copertina di Wired 8.02).

Ma se noi siamo scaricati nella nostra tecnologia, quali sono le possibilità

che da li in poi rimarremo noi stessi o addirittura umani? A me sembra molto più

probabile che l'esistenza robotica non possa essere in nessun senso come quella

umana a noi comprensibile, che i robot non sarebbero in nessun senso i nostri

figli, e che su questo percorso la nostra umanità possa essere

perduta.

L'ingegneria genetica promette di rivoluzionare l'agricoltura

incrementando la produzione del raccolto riducendo l'uso dei pesticidi; creando

decine di migliaia di nuove specie di batteri ,piante, virus, e animali;

sostituendo la procreazione o complementandola, con la clonazione; producendo

cure per molte malattie, aumentando la nostra longevità e qualità della vita; e

molto, molto di più. Adesso sappiamo con certezza che questi profondi

cambiamenti nelle scienze biologiche sono imminenti e contrasteranno tutte le

nostre nozioni sul senso della vita.

Tecnologie come la clonazione umana

hanno alzato in particolare la nostra coscienza dei profondi problemi etici e

morali. Se, per esempio, dovessimo ricostruire noi stessi in alcune specie

separate e ineguali usando il potere dell'ingegneria genetica, allora potrebbe

essere minacciata l'idea di uguaglianza che è la vera pietra miliare della

nostra democrazia.

Dato il potere incredibile dell'ingegneria genetica, non

ci sorprende che ci siano problemi di sicurezza significativi nel suo uso. Il

mio amico Amory Lovins ha recentemente coscritto, insieme con Hunter Lovins, un

editoriale che fornisce una visione ecologica di alcuni di questi pericoli.

Tra le preoccupazioni: "che la nuova botanica allinea lo sviluppo delle

piante con il loro successo economico e non evolutivo".

(vedi "A Tale of Two

Botanies," page 247.)

La lunga carriera di Amory è stata focalizzata su

l'efficacia dell'energia e risorse accettando una visione di "sistema-intero"

per sistemi di fattura umana; tale visione a "sistema-intero" spesso trova

semplici e perspicaci soluzioni per problemi altrimenti apparentemente

difficili, ed è applicato anche qui utilmente.

Dopo aver letto gli editoriali

di Lovins, ho visto un articolo (op-ed) di Gregg Easterbrook sul New York Times

(19 novembre 1999) dei raccolti manipolati geneticamente, titolato: " Cibo per

il futuro: Un giorno il riso avrà in se la vitamina A. A meno che non vincano i

luddisti".

Sono luddisti Amory e Hunter Lovins? Certamente no, credo che saremmo tutti

d'accordo che il riso, con la suainnata vitamina A, è probabilmente una buona

cosa, se sviluppato con la dovuta cura e rispetto per i probabili pericoli nel

muovere i geni attraverso le barriere delle specie.

La coscienza dei pericoli

inerenti all'ingegneria genetica sta cominciando a crescere, come riflette

l'editoriale di Lovins. L'opinione pubblica è cosciente e preoccupata sul cibo

geneticamente modificato, e sembra che respingere la nozione che a tali cibi

possa essere permesso di essere non etichettati.

Ma la tecnologia dell'ingegneria genetica è già molto avanti. Come fanno

notare Lovins, l'USDA ha già approvato circa 50 raccolte geneticamente

modificate per distribuzione illimitata; più di metà dei semi di soia del mondo

e un terzo del granturco ora contiene geni provenienti da altre forme di

vita.

Mentre ci sono importanti questioni qui, la mia principale

preoccupazione riguardo l'ingegneria genetica è ristretta: che da il potere - o

militare, accidentale, o in un deliberato atto terroristico - a creare un "Piaga

Bianca".

Le molte meraviglie della nanotecnologia furono per la prima volta immaginata

dal fisico nobel Richard Feyman in un discorso che dette nel 1959,

successivamente pubblicato sotto il titolo "There's Plenty of Room at the

Bottom."

Il libro che mi colpì molto, verso la metà degli anni '80, fu

"Engines of Creation" di Eric Drexler, dove descrive magnificamente come la

manipolazione a livello atomico possa creare un futuro utopico di abbondanza,

dove quasi ogni cosa possa essere prodotta a basso costo, e quasi ogni tipo di

immaginabile infezione o problema fisico possa essere risolto usando la

nanotecnologia e l'intelligenza artificiale.

Un libro successivo, "Unbounding the Future: The Nanotechnology Revolution",

che Drexler coscrissse, immagina alcuni dei cambiamenti che potrebbero avvenire

in un mondo dove avremmo "assemblatori" a livello molecolare. Gli assemblatori

potrebbero rendere possibile a un incredibile basso-costo cure per il cancro a

energia solare e cure per un comune raffreddore attraverso l'ampliamento del

sistema immunitario umano, essenzialmente completare la pulizia dell'ambiente,

creare incredibili economici supercomputer tascabili - infatti, qualsiasi

prodotto potrebbe essere fabbricato dagli assemblatori ad un costo non maggiore

di quello del legno - rendere viaggi spaziali più accessibili che i viaggi

transoceanici di oggi, e ripristinare le specie estinte.

Ricordo di aver avuto una buona impressione della nanotecnologia dopo aver

letto "Engines of Creation". Da tecnologico, mi ha dato un senso di calma -

ovvero, la nanotecnologia ci dimostrava che incredibili progressi erano

possibili, e di fatto forse inevitabili. Se la nanotecnologia era il nostro

futuro, allora non mi sentivo costretto a risolvere così tanti problemi nel

presente. Avrei raggiunto in tempo il futuro utopico di Dexler; a quel punto

potevo godere al meglio la vita "qui e ora". Non aveva senso, data la sua

visione, di rimanere in piedi tutta la notte, tutto il tempo.

La visione di Drexler portava anche molto divertimento. Occasionalmente mi

ritrovavo a descrivere le meravigle della nanotecnologia ad altri che non ne

avevano sentito parlare. Dopo averli stuzzicati con tutte le cose che aveva

descritto Drexler, gli assegnavo di mio dei compiti per casa: "Usate la

nanotecnologia per creare un vampiro; per punti extra, create anche

l'antitodo".

Con queste meraviglie divennero chiari anche i pericoli, di cui

io ero acutamente cosciente. Come dissi alla conferenza di nanotecnologie nel

1989, "Non possiamo solamente fare la nostra scienza e non preoccuparci dei

problemi etici".(5) Ma la mia seguente conversazione con i fisici mi convinse

che la nanotecnologia non poteva nemmeno funzionare - o, perlomeno non avrebbe

funzionato in tempi brevi. Di li a poco, mi trasferii in Colorado, per uno

lavoraccio che avevo iniziato, e il centro del mio lavoro si spostò sul software

per Internet, specificatamente su le idee che divennero Java e Jini. Poi, la

scorsa estate, Brosl Hasslacher mi disse che l'elettronica molecolare nanoscala

era ora realizzabile. Questa fu una nuova notizia, almeno per me, e penso anche

per molte altre persone - e ha cambiato radicalmente la mia opinione sulla

nanotecnologia. Mi portò indietro alla "Engines of Creation". Rileggendo il

lavoro di Drexler dopo più di 10 anni, fui sconcertato nel rendermi conto come

fosse piccolo il ricordo della sua lunga sezione chiamata "Dangers and Hopes",

"pericoli e speranze" inclusa una discussione di come le nanotecnologie possono

diventare "macchine per la distruzione". Infatti, nella mia rilettura di questo

materiale oggi, sono stupito di quanto naive sembrassero alcune proposte di

difesa di Drexler, e di quanto più grandi giudico adesso essere i pericoli

piuttosto di come li giudicava allora. (Avendo anticipato e descritto molti

problemi tecnici e politici della nanotecnologia, Drexler iniziò al Foresight

Institute negli anni '80 per "aiutare a preparare la società per anticipate

tecnologie avanzate" - più importante, la nanotecnologia).

Rendere possibile

un rapido progresso di assemblare sembra abbastanza probabile entro i prossimi

20 anni. L'elettronica molecolare - il nuovo sotto campo delle nanotecnologia

dove molecole singole sono elementi di circuito - potrebbero maturare

rapidamente e diventare enormemente lucrative entro questa decade, causando ampi

incrementi di investimento in tutte le nanotecnologie.

Sfortunatamente, come con le tecnologie nucleari, è di gran lunga più facile

creare utilizzi distruttivi che costruttivi per le nanotecnologie. Le

nanotecnologie hanno chiari usi militari e terrorostici, e non c'è bisogno di

essere suicidi per utilizzare un apparecchio nanotecnologicamente di massima

distruzione - tali apparecchi possono essere costruiti per essere selettivamente

distruttivi, colpendo, per esempio, solamente una certa area geografica o un

gruppo di persone che sono geneticamente distinti.

Un'immediata conseguenza del Faustiano affare nell'ottenere il grande potere

della nanotecnologia è che corriamo un grave rischio - il rischio che potremmo

distruggere la biosfera dalla quale tutta la vita dipende.

Come spiegava Drexler:

"Piante" con "foglie" non più efficienti delle cellule

solari attuali potrebbero competere con piante reali, affollando la biosfera con

un fogliame non commestibile. Un resistente "batterio "onnivoro potrebbe

sopraffare con reali batteri: potrebbero disperdersi come polline soffiato,

replicarsi rapidamente, e ridurre la biosfera in polvere in pochi giorni.

Pericolosi replicanti potrebbero facilmente essere troppo forti, minuti e

rapidamente sparsi per essere fermati - a meno che non siamo preparati. Abbiamo

già abbastanza problemi per controllare i virus e i pidocchi della frutti.

Tra intenditori di nanotecnologie, queste minacce sono diventate note come

"gray goo problem". Sebbene masse di replicatori incontrollati non debbano

essere ne grigi o appiccicosi, il termine "gray goo" enfatizza che i replicatori

capaci di cancellare la vita potrebbero essere meno coinvolgenti che una singola

specie di erbacce. Potrebbero essere superiori in un senso evolutivo, ma questo

non vuol dire che siano preziosi.

La minaccia "gray goo" rende perfettamente

chiara una cosa: non possiamo permetterci certi tipi i di incidenti con

assemblatori replicanti. "Gray goo" potrebbe sicuramente essere una fine

deprimente della nostra avventura umana sulla terra, molto peggio del fuoco o

del ghiaccio, o di un arginabile semplice incidente di laboratorio. (6)oops

E' sopratutto il potere di autoreplicazione distruttiva in genetica,

nonotecnologia e robotica (GNR) che dovrebbero fermarci. L'auto-replicazione è

il Modus Operandi dell'ingegneria genetica, che usa il meccanismo delle cellule

per replicare le proprie architetture, e il primario pericolo sottostante al

"gray goo" in nanotecnologia. Storie di robots "run-amuk" (che corrono qua e la

presi da una pazzia sanguinaria) come i Borg, replicando o mutando per sfuggire

alle limitazioni etiche imposte dai loro creatori, sono ben affermate nei nostri

libri e film di fantascienza. E' anche possibile che l'auto-replicazione possa

essere più necessaria di quanto pensiamo, e quindi più difficile - o anche

impossibile - da controllare. Un recente articolo di Stuart Kauffman in

"Nature", titolato "Self-Replication: Even Peptides Do It" trattava la scoperta

che 32-peptidi-amino-acidi possono "autocatalizzare la propria sintesi". Non

sappiamo come questa abilità possa diffondersi, ma Kauffman nota che ciò può far

supporre "un percorso verso sistemi molecolari di auto-riproduzione sulla base

molto più estesa del principio di accoppiamento di Watson-Crick. (7)

In verità, abbiamo avuto nelle mani per anni chiare ammonizioni dei pericoli

inerenti alle vaste conoscenze delle tecnologie GNR - delle possibilità di

conoscenza che permettessero da sole distruzioni di massa. Ma questi ammonimenti

non sono stati ampiamente pubblicizzati; le discussioni pubbliche sono state

chiaramente inadeguate. Non c'è alcun profitto nella pubblicizzazione dei

pericoli.

Le tecnologie nucleari, biologiche e chimiche (NBC) usate nelle armi di

distruzione di massa del 20esimo secolo furono e sono in gran parte militari,

sviluppate e costruite nei laboratori statali. In netto contrasto le tecnologie

GNR del 21° secolo hanno un chiaro utilizzo commerciale e le stanno sviluppando

quasi esclusivamente le imprese private. In questa epoca della trionfante

commercializzazione, la tecnologia - con la scienza come sua aiutante sta

consegnando una serie di invenzioni quasi magiche che sono le più fenomenalmente

lucrative mai viste. Siamo aggressivamente inseguiti dalle promesse di queste

nuove tecnologie dentro l'attuale indiscusso sistema del capitalismo globale e

dei suoi numerosi incentivi finanziari e pressioni competitive.

Questo è

il primo momento nella storia del nostro pianeta in cui qualsiasi specie, a

causa della propria azione volontaria, è diventata pericolosa per se stessa -

tanto quanto ad un grande numero di altri.

Potrebbe essere una progressione familiare, trapelata in molti mondi - un

pianeta, di nuova formazione, che placidamente si evolve intorno alla sua

stella; la vita si forma lentamente; una processione caleidoscopica di creature

si evolve; l'intelligenza emerge e, almeno fino ad un certo punto, conferisce un

enorme valore di sopravvivenza; e allora la tecnologia è inventata.

Viene in

mente che ci sono cose come leggi della natura, le quali possono essere svelate

dagli esperimenti, e che la conoscenza di queste leggi può essere fatta sia per

salvare e per prendere vita, sia su scale sconosciute. La scienza, lo

riconoscono, concede immensi poteri. In un attimo essi creano dispositivi per

l'alterazione del mondo. Alcune civiltà planetarie vedono il loro percorso,

pongono limiti su ciò che si può e non si deve fare, e passano con sicurezza

tempi pericolosi. Altri, non così fortunati o prudenti, periscono.

Questi era Carl Sagan, scrivendo nel 1994, in "Pale Blue Dot", un libro che

descrive la sua visione del futuro umano nello spazio. Solo adesso mi sto

rendendo conto come fosse profonda la sua intuizione, e come dolorosamente sento

e sentirò la mancanza, della sua voce. Per tutta la sua eloquenza, il contributo

di Sagan non fu meno di un semplice buon senso - un attributo che, assieme

all'umiltà, sembrano mancare in molti dei difensori principali delle tecnologie

del 21esimo secolo.

Ricordo durante la mia infanzia che mia nonna era fortemente contro l'abuso

degli antibiotici. Aveva lavorato fino a prima della I Guerra Mondiale come

infermiera e aveva il buon senso di pensare che prendere gli antibiotici, a meno

che non fosse stato assolutamente necessario, facesse male.

Non che fosse una

nemica del progresso. Aveva visto talmente tanto progresso in quasi 70 anni di

carriera infermieristica; mio nonno, un diabetico, ha beneficiato moltissimo

delle cure avanzate che diventavano disponibili durante la sua vita. Ma lei,

così come molte altre persone equilibrate, penserebbe che sia di grande

arroganza, ora, progettare una "specie di rimpiazzo" robotico, mentre abbiamo

così tanti problemi a far funzionare cose relativamente semplici, e abbiamo così

tante difficoltà a gestire - o addirittura a capire - noi stessi.

Ho realizzato ora che lei aveva una consapevolezza sulla natura dell'ordine

della vita, e sulla necessità di vivere e convivere con questo ordine. Con

questo rispetto diviene necessario un'umiltà che siamo manchevoli, al nostro

pericolo. La visione "di buon senso", impregnata in questo rispetto, è spesso

giusta, in anticipo alla dimostrazione scientifica. La chiara fragilità ed

inefficienza dei sistemi umani che abbiamo costruito dovrebbe dare a tutti noi

una pausa; la fragilità dei sistemi sui quali ho lavorato certamente mi rende

umile.

Avremmo dovuto imparare una lezione dalla fabbricazione della prima bomba

atomica e dal risultato della corsa agli armamenti. Non facemmo bene allora, e

il parallelismo della situazione corrente è preoccupante.

Lo sforzo per costruire la prima bomba atomica fu condotta dal brillante

fisico J. Robert Oppenheimer. Oppenheimer non era evidentemente interessato

nella politica ma diventò dolorosamente consapevole di ciò che egli percepiva

come una minaccia grave alla civiltà occidentale a partire dal Terzo Reich, una

minaccia sicuramente grave a causa della possibilità che Hitler potesse ottenere

armamenti nucleari. Stimolato da questa preoccupazione, portò le sue

caratteristiche di forte intelletto, passione per la fisica, e di leadership

carismatica a Los Alamos e condusse un rapido e fruttuoso sforzo con

l'incredibile unione di grandi menti per inventare velocemente la bomba.

Ciò che sorprende è come questi sforzi siano

continuati così naturalmente dopo che era stato rimosso l'iniziale impeto.

Ciò che sorprende è come questi sforzi siano

continuati così naturalmente dopo che era stato rimosso l'iniziale impeto.

In

una riunione poco dopo il V-E Day con alcuni fisici che sentivano che forse gli

sforzi dovevano essere finiti, Oppenheimer insistette per continuare. La sua

dichiarata ragione sembrava un po' strana: non era per la paura di molte vittime

dovute ad una invasione del Giappone, ma perché le Nazioni Unite, che da li a

poco sarebbero state costituite, dovevano avere una pre-conoscenza delle armi

atomiche. Una ragione più probabile per cui il progetto continuò è dovuta al

momentum che lo costituì - il primo test atomico, Trinity, era quasi a portata

di mano.

Sappiamo che preparando questo primo test atomico i fisici

procedettero nonostante un gran numero di possibili pericoli. Inizialmente erano

preoccupati, basandosi su un calcolo di Edward Teller, che un'esplosione atomica

poteva incendiare l'atmosfera. Un calcolo rivisto, ridusse il pericolo di

distruzione del mondo ad un terzo di un milione di possibilità. (Teller dice che

più tardi era in grado di smentire completamente la prospettiva di combustione

atmosferica). Oppenheimer, benchè fosse abbastanza preoccupato per i risultati

di Trinity dispose per una possibile evacuazione della parte Sudovest dello

Stato del New Mexico. E, naturalmente, c'era il chiaro pericolo di un inizio

alla corsa di armi nucleari.

Entro un mese dal primo test di successo, 2

bombe atomiche distrussero Hiroshima e Nagasaki. Alcuni scienziati suggerirono

che le bombe dovevano essere semplicemente dimostrate, piuttosto che buttate

sulle città giapponesi - dicendo che questo avrebbe migliorato la possibilità di

controllo delle armi dopo la guerra - ma senza alcun esito.

Con la tragedia

di Pearl Harbor ancora fresco nelle menti americane, sarebbe stato molto

difficile per il presidente Truman di ordinare una dimostrazione di armi

piuttosto che usarle come ha fatto - il desiderio di finire velocemente la

guerra e salvare le vite che sarebbero state perse in un'invasione del Giappone

era molto forte. Ma, la sovrastante verità venuta era probabilmente molto

semplice: Come disse il fisico Freeman Dyson più tardi: "La ragione per cui è

stata buttata fu che nessuno ebbe il coraggio o la previsione di dire no".

E' importante rendersi conto come erano attoniti i fisici in seguito al

bombardamento di Hiroshima, il 6 Agosto del 1945. Essi descrissero una serie di

onde di emozioni: prima un senso di soddisfazione che la bomba aveva funzionato,

poi l'orrore per tutta la gente che era stata uccisa, e ancora un convincente

sentimento che per nessuna ragione un'altra bomba doveva essere buttata. Ma

naturalmente un'altra bomba fu lanciata, su Nagasaky, solo tre giorni dopo il

bombardamento di Hiroshima.

Nel novembre del 1945, tre mesi dopo il

bombardamento atomico, Oppenheimer si pose fermamente dietro la posizione

scientifica, dicendo: "Non è possibile essere uno scienziato senza credere che

il sapere del mondo, e il potere che gli conferisce, è cosa di intrinseco valore

per l'umanità, e che lo stai usando per aiutare l'espansione della conoscenza e

sei disposto ad accettarne le conseguenze".

Oppenheimer cominciò a lavorare, con altri, al rapporto Acheson-Lilienthal,

il quale, come disse Richard Rhodes in un suo recente libro, " Visions of

Technology" - "Trovata una via per prevenire la corsa all'armamento nucleare

clandestino senza risultare ai governi armati mondiali"; il loro suggerimento

era di rinuncia del lavoro sulle armi nucleari per gli stati - nazione ad una

agenzia Internazionale.

Questa proposta condusse al Progetto Baruch, il

quale fu sottomesso alle Nazioni Unite nel giugno del 1946 ma mai adottato

(forse perché, come suggeriva Rhodes, Bernard Baruch aveva "insistito nel

seppellire il progetto di sanzioni convenzionali", per cui inevitabilmente

rovinandolo, anche se sarebbe stato "quasi certamente rigettato in ogni caso

dalla Russia Stalinista"). Altri sforzi per favorire passi intelligenti verso

l'internazionalizzazione del potere nucleare per prevenire una corsa agli

armamenti si condussero in contrasto sia con la politica statunitense e

l'interna diffidenza, o sospetto dei Sovietici. L'opportunità di sfuggire alla

corsa alle armi fu persa, e molto velocemente.

Due anni più tardi, nel 1948,

Oppenheimer sembrava aver raggiunto un altro stato nel suo pensiero, dicendo:

"In uno strano crudo senso che nessuna volgarità, nessun humor, nessuna

dichiarazione può estinguere, i fisici hanno conosciuto il peccato; e questo è

un sapere che non possono perdere".

Nel 1949, i Sovietici esplosero una bomba atomica. Dal 1955, sia gli USA che

Unione Sovietica, testarono bombe all'idrogeno adatte al rifornimento aereo. E

così iniziò la corsa alle armi nucleari.

Circa 20 anni fa, nel documentario

"The Day After Trinity", Freeman Dyson riassunse le posizioni scientifiche che

ci portarono al precipizio nucleare.

"Io stesso l'ho sentito. Lo splendore

delle armi nucleari. E' irresistibile, se vieni a loro come scienziato. Sentirlo

che è li, nelle tue mani, sentire questa energia che irrora le stelle,

lasciandogli fare la tua preghiera.

Di fare questi miracoli, di alzare

milioni di tonnellate di pietre verso il cielo. E qualcosa che da alla gente

un'illusione di un illimitato potere, ed è, in alcun modo, responsabile di tutti

i nostri guai - questo, che potreste chiamare arroganza tecnicistica, che

soggioga le persone quando realizzano cosa possono fare con le loro menti.(8)

Oggi, come allora, siamo creatori di nuove tecnologie e stelle del futuro

immaginato, guidati - questa volta da grandi ricompense finanziarie e

competizioni globali - nonostante i chiari pericoli, difficilmente valutando

come possa essere provare a vivere in un mondo che è il realistico risultato di

ciò che stiamo creando e immaginando.

Nel 1947, The Bulletin of the Atomic Scientists cominciò a mettere il

Doomsday Clock (l'orologio del giorno del giudizio) sulla sua copertina.

Per

oltre 50 anni, ha dimostrato una valutazione dei pericoli relativi al nucleare

che abbiamo di fronte, riflettendo le mutevoli condizioni internazionali. Le

lancette dell'orologio sono state mosse 15 volte e oggi, a nove minuti a

mezzanotte, riflettono il continuo e reale pericolo delle armi nucleari. La

recente aggiunta dell'India e del Pakistan alla lista dei detentori del potere

nucleare ha aumentato la minaccia di fallimento dell'obiettivo di

nonproliferazione, e questo pericolo era apparso muovendo le lancette più vicino

alla mezzanotte nel 1998.

Ai giorni nostri, quanti pericoli abbiamo di

fronte, non solo dagli armamenti nucleari, ma da tutte queste tecnologie? Quanto

è alto il rischio di estinzione?

Il filosofo Jhon Leslie ha studiato queste domande e ha concluso che il

rischio di estinzione umana è almeno il 30% (9), mentre Ray Kurzweil crede che

abbiamo "una migliore opportunità di farcela, con l'obiezione per cui è sempre

stato accusato di essere ottimista. Non solo queste previsioni non sono

incoraggianti ma non includono neanche la possibilità di alcuni orrendi

risultati vicini all'estinzione.

Confrontati con tali asserzioni alcune persone serie suggeriscono di

andarsene dalla terra al più presto possibile. Colonizzeremo la galassia

utilizzando le sonde? di Von Neumann che passano da sistema stellare a sistema

stellare. Per questo passo saranno necessari 5 miliardi di anni da ora (o al più

presto se il nostro sistema solare sarà disastrosamente colpito dall'imminente

collisione della nostra galassia con la galassia di Andromeda nei prossimi 3

miliardi di anni. Ma se prendiamo per buona la parola di Kurzweil e Moravec ciò

potrebbe essere necessario per la metà di questo secolo.

Quali sono qui le

implicazioni morali?

Se dobbiamo andarcene dalla terra così presto affinchè

sopravviva la nostra specie, chi accetterà la responsabilità per il destino di

coloro (alla fine quasi tutti noi) che saranno lasciati indietro?

Anche se ci

sparpagliamo nelle stelle, non è probabile che ci porteremo i nostri problemi

con noi o che più tardi ci raggiungeranno? Il destino della nostra specie sulla

terra o il destino sulle galassie sembrano inestricabilmente

congiunti.

Un'altra idea è di innalzare una serie di scudi per difendersi

contro ciascuna delle tecnologie pericolose. L'Iniziativa di Difesa Strategica,

proposta dall'Amministrazione Reagan, fu un tentativo di progettare uno scudo

contro la minaccia di un attacco nucleare da parte dell'Unione Sovietica. Ma

come osservò Arthur C. Clarke, interessato a trattare sul progetto: "Benchè

fosse possibile, una immensa spesa per costruire sistemi di difesa locale che

avrebbero lasciato passare "solo" una piccola percentuale di missili balistici,

la più sollecitata idea di un ombrello nazionale era

assurda-senza-senso.

Luis Alvarez, forse il più grande fisico sperimentale di

questo secolo, mi fece notare che i difensori di questi schemi erano "tipi molto

chiari con un senso non comune".

Clarke continuava: "Guardando dentro la mia

sfera di cristallo spesso nebulosa, sospetto che una totale difesa potrebbe

infatti essere possibile tra più o meno un secolo. Ma la tecnologia in questione

produrrebbe, come un effetto collaterale, armi così terribili che nessuno

perderebbe tempo con qualcosa come missili balistici primitivi". (10)

In "Engines of Creation", Eric Drexler propose che noi avremmo costruito uno

scudo di difesa attivo nanotecnologico - una forma di sistema immunitario per la

biosfera - per difendersi contro i pericolosi replicatori di ogni tipo che

possono sfuggire dai laboratori o essere creati con malintenzione. Ma lo stesso

scudo proposto sarebbe estremamente pericoloso - niente potrebbe impedirgli

sviluppare problema autoimmuni e di attaccare la stessa biosfera. (11)

Simili difficoltà concernono la costruzione di scudi contro l'ingegneria

genetica e la robotica. Queste tecnologie sono troppo potenti per crearsi uno

scudo in tempo necessario.

Anche se fosse possibile implementare scudi di

difesa, gli effetti collaterali del loro sviluppo sarebbero tanto pericolosi

quanto le tecnologie da cui ci vogliamo difendere.

Tutte queste possibilità

sono indesiderabili o irrealizzabili o entrambi. L'unica alternativa realistica

che io vedo è la rinuncia: limitare lo sviluppo delle tecnologie che sono troppo

pericolose, limitando la nostra aspirazione a certi tipi di conoscenza.

Si,

lo so, il sapere è buono, visto che è la ricerca di nuove verità. Noi stiamo

cercando la conoscenza da tempi antichi. Aristotele apriva la sua "Metafisica"

con una semplice espressione: "Tutti gli uomini per loro natura desiderano

sapere". Abbiamo come principio fondamentale nella nostra società, concordato a

lungo sul valore dell'accesso libero all'informazione e riconosciuto quali

problemi sorgono col tentativo di limitare l'accesso alla conoscenza ed il suo

sviluppo.

Negli ultimi tempi, siamo arrivati ad onorare il sapere

scientifico.

Ma nonostante i forti precedenti storici, se l'accesso allo

sviluppo illimitato della conoscenza d'ora in avanti ci pone tutti in serio

pericolo di estinzione, allora il buon senso richiede che rivediamo di nuovo le

nostre basi, convinzioni a lungo sostenute. Era Nietzsche ad ammonirci, alla fine del 19esimo secolo, non solo che

Dio era morto ma che "la fiducia nella scienza, che tuttavia esiste

innegabilmente, non può avere le sue origini da un calcolo di utilità; deve

essere stata originata a prescindere dal fatto che l'inutilità e la pericolosità

della volonta di "verità" "verità ad ogni prezzo" gli sia provata

costantemente". Questo successivo pericolo con cui adesso ci imbattiamo

completamente - le conseguenze della nostra ricerca di verità. La verità che la

scienza ricerca può certamente essere considerata un sostituto pericoloso di Dio

se è possibile che ci conduca alla nostra estinzione.

Se potessimo

concordare, come specie, che cosa volessimo, dove vogliamo arrivare, e perché,

allora il nostro futuro sarebbe molto meno pericoloso - allora potremmo capire

che cosa possiamo e vorremmo abbandonare. Altrimenti possiamo facilmente

immaginare la corsa agli armamenti sulle tecnologie GNR, così come è successo

con le tecnologie NBC nel 20esimo secolo. Questo è forse il rischio più grande,

una volta iniziata tale corsa, è molto difficile terminarla.

Questa volta -

a differenza del Progetto di Manhattan - non siamo in guerra, di fronte ad un

implacabile nemico che minaccia la nostra civiltà; siamo guidati, invece, dalle

nostre abitudini, i nostri desideri, il nostro sistema economico, e la nostra

necessità competitiva di sapere.

Credo che tutti desideriamo che il nostro

destino sia determinato dai nostri valori collettivi, etici e morali. Se

avessimo acquistato più saggezza collettiva nelle passate migliaia di anni,

allora un dialogo verso questo fine sarebbe molto più pratico, e l'incredibile

potere che stiamo per scatenare non sarebbe poi così preoccupante.

Uno tenderebbe a pensare che tale dialogo sarebbe condotto dal nostro istinto

di auto conservazione.

Gli individui chiaramente hanno questo desiderio,

però come specie il nostro comportamento sembra non essere a nostro favore.

Confrontandoci con la minaccia nucleare, spesso abbiamo parlato in modo

disonesto-sleale incrementando enormemente i rischi. Se questo era politicamente

motivato, o perche abbiamo preferito non pensarci, o perché quando di fronte a

tali minacce abbiamo agito irrazionalmente per la paura, io non lo so, comunque

non è un buon presagio.

nostro favore.

Confrontandoci con la minaccia nucleare, spesso abbiamo parlato in modo

disonesto-sleale incrementando enormemente i rischi. Se questo era politicamente

motivato, o perche abbiamo preferito non pensarci, o perché quando di fronte a

tali minacce abbiamo agito irrazionalmente per la paura, io non lo so, comunque

non è un buon presagio.

Il nuovo vaso di Pandora di genetica, nanotecnologia,

e robotica è quasi aperto, però non lo abbiamo notato. Le idee non possono

essere ricacciate nel vaso; a differenza dell'uranio o il plutonio, non devono

essere minate o raffinate, e possono essere liberamente copiati. Una volta

fuori, sono fuori. Churchill fece notare, in un suo famoso complimento "di

sinistra", che il popolo americano e i loro leaders "invariabilmente fanno la

cosa giusta, dopo che hanno esaminato ogni altra alternativa". In questo caso

tuttavia, dobbiamo agire previdentemente, visto che fare la cosa giusta in

ultima istanza potrebbe significare perdere la possibilità di fare qualsiasi

cosa.

Come ha detto Thoreau, "Non viaggiamo sulle rotaie; sono le rotaie che

viaggiano su di noi;" e questo è ciò che dobbiamo combattere, nel nostro tempo.

La questione invece è:

Chi deve essere il dominatore? Sopravviveremo alle

nostre tecnologie?

Siamo spinti avanti in questo nuovo secolo senza nessun piano, nessun

controllo, senza freni. Siamo già andati troppo in la' per cambiare

direzione?

Io non credo, ma non stiamo ancora provando, e l'ultima

possibilità per affermare il controllo - il punto di infallibilità - si avvicina

velocemente. Abbiamo i nostri primi robot domestici, come pure tecniche di

ingegneria genetica commercialmente disponibile, e le nostre tecniche nanoscale

stanno progredendo rapidamente.

Mentre lo sviluppo di queste tecnologie procede attraverso un grande numero

di passi, non è dovuto che - come è successo nel Progetto Manhattan e nel Test

Trinity - l'ultimo passo nel dimostrare la validità di una tecnologia sia grande

e difficile. La rottura verso l'auto-replicazione selvaggia della robotica,

l'ingegneria genetica, o la nanotecnologia potrebbe arrivare all'improvviso,

ravvivando la sorpresa che sentimmo quando venimmo a conoscenza per la prima

volta della clonazione dei mammiferi.

E ancora credo che non abbiamo una base

forte e solida per sperare. I nostri tentativi di trattare con le armi di

distruzione di massa nell'ultimo secolo sono un brillante esempio di rinuncia

che ci fa riflettere: l'abbandono unilaterale statunitense, incondizionato, di

sviluppo di armi biologiche.

Questa rinuncia emerse una volta realizzato, che

mentre sarebbe stato un sforzo enorme creare queste terribili armi, avrebbero

potuto da li in poi facilmente essere duplicate e cadere nelle mani di nazioni

nemiche o gruppi terroristici.

La chiara conclusione fu che avremmo creato

ulteriori minacce comprando queste armi, e che sarebbe stato più sicuro non

comprarle. Abbiamo sussunto il nostro abbandono delle armi chimiche e biologiche

nel 1972 con la Convenzione delle Armi Biologiche (BWC) e nel 1993 con la

Convenzione delle Armi Chimiche (CWC). (12)

Per quanto riguarda la continua minaccia delle armi nucleari, con cui abbiamo

vissuto ormai per circa più di 50 anni, il rifiuto del senato Statunitense del

Comprehensive Test Ban Treaty chiarisce che l'abbandono delle armi nucleari non

sarà politicamente facile. Ma abbiamo solo una opportunità, con la fine della

guerra fredda, di contrastare una corsa alle armi multipolare.

In base agli

abbandoni della BWC e CWC, il successo dell'abolizione di armi nucleari potrebbe

aiutarci a costruire l'abitudine ad abbandonare tecnologie pericolose.

(Attualmente, disfacendosi di tutte, tranne 100 armi nucleari, mondialmente -

all'incirca l'intero potere distruttivo della II Guerra Mondiale - potremmo

eliminare il pericolo di estinzione). (13)

Verificarne l'abbandono sarebbe un problema difficile, ma non irrisolvibile.

Siamo fortunati ad aver già fatto parecchio lavoro importante nel contesto di

BWC ed altri accordi. Il nostro principale compito sarà di applicare questo alle

tecnologie che sono naturlamente molto più commerciali che militari. Il bisogno

sostanziale è della trasparenza giacchè la difficoltà di verifica è direttamente

proporzionale alla difficoltà di distinzione tra attività legittime e le

restanti.

Francamente credo che la situazione nel 1945 era più facile di quella con cui

ci confrontiamo ora: le tecnologie nucleari erano ragionevolmente separabili tra

uso commerciale e militare, e il monitoraggio era facilitato dalla stessa natura

dei test atomici e dalla facilità con cui poteva essere misurata la

radio-attività.

La ricerca su applicativi militari poteva essere condotta in

laboratori nazionali come Los Alamos, con i risultati mantenuti segreti al più

lungo possibile.

Le tecnologie GNR non si dividono chiaramente in utilizzo

commerciale o militare; dato il ,loro potenziale nel mercato è difficile

immaginarne l'acquisto nei soli laboratori statali. Con la loro diffusa

richiesta commerciale, costringere alla rinuncia richiederà un regime di

verifica simile a quello per le armi biologiche ma ad una livello senza

precedenti. Questo inevitabilmente aumenterà la tensione tra la nostra privacy

ed il desiderio di informazioni proprietarie, e la necessità di verifica per

proteggerci tutti.

Senza dubbio incontreremo una forte resistenza a questa

perdita di privacy e libertà di azione.

La verifica della rinuncia di certe tecnologie GNR dovrà avvenire nel

cyberspazio quanto nel mondo fisico. Il punto critico sarà di creare la

necessaria trasparenza in mondo di informazioni di proprietà, presumibilmente

provvedendo a nuove forme di protezione sulla proprietà

intellettuale.

Verificare la messa a norma richiederà che gli scienziati e

gli ingegneri, adottino un forte codice di condotta etica, richiamando il

giuramento di Ippocrate, avranno il coraggio imporsi quando necessario anche ad

un alto rischio personale.

Questo risponderebbe alla chiamata - 50 anni dopo

Hiroshima - del Premio Nobel Hans Bethe, uno dei più anziani membri viventi del

Manhattan Project, che dice "cessate il lavoro, desistete dal creare,

sviluppare, migliorare e produrre armi nucleari o altre armi con la potenzialità

di distruzione di massa".

Nel 21° secolo ciò richiede vigilanza,

responsabilità personale da parte di coloro che lavorerebbero sia con tecnologie

NBC e GNR per evitare l'imlementazione di armi di distruzione di massa e la

distruzione di massa abilitata dal sapere.

Thoreau diceva anche che saremmo "ricchi in proporzione al numero di cose di

cui possiamo fare a meno" Ognuno di noi cerca la felicità, ma sembrerebbe

opportuno chiederci se dobbiamo rischiare così tanto, la totale distruzione, per

acquisire ancora più sapere e più cose; il buon senso dice che c'è un limite

alle nostre necessità materiali e che alcuni saperi sono troppo pericolosi

quindi meglio dimenticati.

Non dovremmo nemmeno ricercare una vicina

immortalità senza considerarne i costi, senza considerare il commisurato

incremento del rischio di estinzione . L'immortalità, mentre forse è originale,

non è certamente il solo possibile sogno utopico.

Recentemente ho avuto la

fortuna di incontrare lo stimato autore Jacques Attali, di cui il libro "Lignes

d'horizons" (Millennium, nella traduzione in inglese) ha aiutato a ispirare

l'approccio Java e Jini dell'arrivo dei computer pervasivi, come descritti

precedentemente in questa rivista. Nel suo nuovo libro "Fraternites", Attali

descrive come i nostri sogni di utopia siano cambiati nel

tempo:

"All'alba delle società, gli uomini videro il loro passaggio sulla

terra come niente di più che un labirinto di dolore, alla fine della quale vi è

posta una porta che conduce, attraverso la loro morte, alla compagnia degli Dei

e dell'eternità. Con i giudei e poi con i greci, alcuni uomini osarono liberarsi

dai comandamenti teologici e sognarono di una Città ideale dove sarebbe

prosperata la libertà. Altri, notando lo sviluppo della società mercato,

capirono che la libertà di qualcuno avrebbe potuto recare l'alienazione di

altri, e cercarono l'Eguaglianza".

Jacques mi aiutò a capire come questi tre diversi obiettivi utopici esistono

con molta tensione nelle nostre società di oggi. Poi prosegue descrivendo la

quarta utopia, Fraternità, di cui il fondamento è l'altruismo. Fraternità da

sola è associata a felicità individuale con la felicità di altri, fornendo la

promessa di autosostentamento.

Questo ha cristallizzato il mio problema con

il sogno di Kurzweil. Un approccio tecnologico all'eternità - una vicina

immortalità attraverso la robotica - potrebbe non essere l'utopia più

desiderabile, e la sua aspirazione porta chiari pericoli. Forse dovremmo

riconsiderare le nostre scelte utopiche.

Dove possiamo cercare una nuova

etica di base per situare il nostro percorso? Ho trovato le idee incluse nel

libro "Ethics for the new Millenium", del Dalai Lama, molto utili. Mentre è

molto conosciuto, ma poco ascoltato, il Dalai Lama dice che la cosa più

importante è per noi condurre la nostra vita con amore e compassione per gli

altri, e che le nostre società hanno bisogno di sviluppare una nozione più forte

di responsabilità universale e della nostra interdipendenza; egli propone uno

standard di condotta eticamente positiva per individui e società che sembrano

consonanti con l'utopia di Fraternità di Attali.

Il Dalai Lama continua

argomentando che dobbiamo capire cos'è che fa felice la gente, e ammette la

forte evidenza che né il progresso materiale nè l'aspirazione del potere di

conoscenza è la chiave - che ci sono limiti a quello che la scienza e

l'aspirazione scentifica da sola può fare.

La nostra nozione occidentale di

felicità sembra provenire dai Greci, che la definiscono come "l'esercizio del

potere vitale lungo binari di eccellenza in una vita che comprenda il loro

scopo". (15)

Chiaramente, dobbiamo trovare significative sfide e sufficienti scopi nella

nostra vita se vogliamo essere felici nonostante ciò che verrà. Ma credo che

dobbiamo trovare sbocchi alternativi per le nostre forze creative, al di la

della cultura di crescita economica eterna; questa crescita è stata certamente

una benedizione per centinaia di anni, ma non ci ha portato pura felicità e ora

dobbiamo scegliere tra aspirazioni di libretà e sviluppo indiretto attraverso

scienza e tecnologia con i pericoli che lo accompagna.(10)

E' passato più di un anno dal mio primo incontro con Ray Kurzweil e John

Searle. Vedo intorno a me un motivo per avere la speranza nelle voci per la

cautela e nella rinuncia e in quelle persone che ho scoperto preoccupate come me

sulla nostra attuale condizione. Provo, anch'io, un profondo senso di

responsabilità personale - non per il lavoro che ho già fatto, ma per il lavoro

che dovrò ancora fare, al punto di confluenza delle scienze.

Ma molte altre

persone che conoscono i pericoli tuttavia sembrano stranamente silenziose. Se

sollecitate , se ne escono con "non c'è niente di nuovo" - come se la

consapevolezza di ciò che potrebbe accadere fosse una risposta sufficiente. Mi

dicono, ci sono università piene di bioetici che studiano questo, tutto il

giorno. Dicono, "tutto questo è stato scritto da prima, e da esperti". Si

lamentano, le tue preoccupazioni e i tuoi argomenti sono scarpe vecchie.

Non so dove questa gente nasconde la paura. Come architetto di sistemi

complessi entro in questa arena come un generico. Ma questo dovrebbe diminuire

le mie preoccupazioni? Sono consapevole di quanto sia stato scritto, detto e

letto su questo in modo così autorevole. Ma questo significa che ha raggiunto

persone? Questo significa che possiamo sminuire i pericoli che abbiamo

davanti?

Il sapere non è un movente per non agire. Possiamo dubitare che il

sapere sia diventata un'arma che maneggiamo contro noi stessi?

Le esperienze

degli scienziati atomici dimostrano chiaramente la necessità di prendere

responsabilità personali, il pericolo che le cose si muoveranno troppo

velocemente, e il modo in cui un processo può prendere vita propria. Noi

possiamo, come loro, creare problemi insormontabili in pochissimo tempo.

Dobbiamo pensare di più in anticipo se non vogliamo essere sorpresi e colpiti

dalle conseguenze delle nostre invenzioni.

Il mio continuo lavoro

professionale è migliorare la affidabilità del software. Il software è uno

strumento, e come progettista di tali strumenti devo sforzarmi a controllare gli

utilizzi degli strumenti che faccio. Ho sempre creduto che facendo i software

più affidabili, dati i suoi utilizzi, avrebbero reso il mondo più sicuro e un

posto migliore; se dovessimo arrivare a pensare al contrario, allora sarei

moralmente obbligato a fermare il mio lavoro. Posso immaginare che tale giorno

arriverà.

Tutto questo non mi lascia arrabbiato ma un po' malinconico. D'ora in poi,

per me, il progresso sarà alquanto agrodolce.

Vi ricordate la penultima e

bellissima scena in "Manhattan", dove Woody Allen sta sdraiato sul suo lettino

parlando al registratore? Sta scrivendo una piccola storia sulla gente che sta

creando inutili neurotici problemi a se stessa, perché li trattiene dal

confrontarsi con i più irrisolvibili e terrificanti problemi

sull'universo.

Guida se stesso a chiedersi: "Perché la vita merita di essere

vissuta?" e considera cosa vale la pena per loro: Groucho Marx, Willie Mays, il

secondo movimento della Jupiter Symphony, la registrazione di Louis Armstrong di

"Potato Head Blues", i film svedesi, l'educazione sentimentale di Flaubert,

Marlon Brando, Frank Sinatra, le mele e le pere di Cezanne, i granchi a Sam

Wo's, e, alla fine, il pezzo forte: la faccia del suo amore Tracy.

Ciascuno di noi ha le proprie cose preziose, e come le curiamo, localizziamo

l'essenza della nostra umanità. Alla fine, è per la nostra grande capacità di

avere cura che rimango ottimista nel credere che affronteremo i pericoli

prodotti.

La mia immediata speranza è partecipare in una discussione molto

più ampia sui problemi qui sollevati, con persone provenienti da diversi

passati, modo non predisposto all'ansia o favorire tecnologie per il suo proprio

interesse.

Come inizio ho doppiamente portato molti di questi problemi ad

eventi sponsorizzati da l'Aspen Institute e ho separatamente proposto che

l'Accademia Americana delle Arti e delle Scienze li prendesse come estensione

del proprio lavoro con le Conferenze Pugwash. (Queste si tengono dal 1957 per

discutere il controllo delle armi, specialmente delle armi nucleari, e per

formulare regole fattibili).

E' una sfortuna che i meetings di Pugwash cominciati solo dopo il genio

nucleare era uscito dalla lampada - all'incirca 15 anni dopo. Stiamo avendo

anche un ritardo nell' indirizzare seriamente i problemi delle tecnologie del

21° secolo - la prevenzione del sapere abilitato alla distruzione di massa - e

ulteriori ritardi sembrano inaccettabili.

Quindi sto ancora ricercando; ci sono ancora molte cose da imparare. Se siamo